Warum sie bleibt – und warum sie erwachsen wird Nach Technik, Architektur und Praxis stellt sich die eigentliche Frage:

Was kommt als Nächstes? Lokale KI ist kein Übergangsphänomen und kein

-

-

Vom Tool-Denken zum System-Denken Bis hierher hast du Werkzeuge kennengelernt. Jetzt geht es um Haltung. Denn die größten Probleme mit lokaler KI entstehen nicht durch Technik – sondern durch

-

Warum lokale KI kein Selbstläufer ist – aber ein starkes Argument Lokale KI wird oft mit einem Schlagwort verkauft: Datenschutz. Das stimmt – wenn man sie richtig betreibt. Dieser Teil zeigt,

-

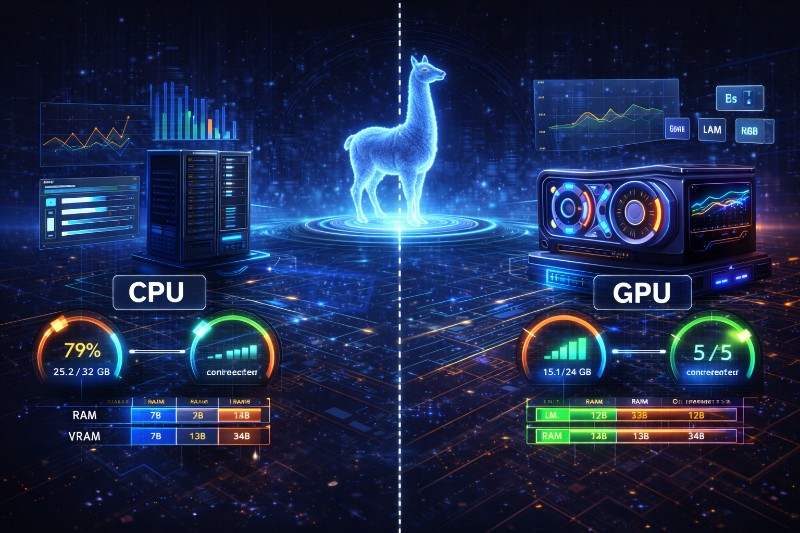

Warum lokale KI keine Cloud ist – und genau deshalb planbar sein muss Spätestens nach den ersten produktiven Tests kommt der Realitätscheck: Antworten dauern länger als erwartet, der RAM läuft

-

Wenn KI nicht mehr antwortet – sondern arbeitet Bis hierher war Ollama vor allem eines: ein intelligenter Gesprächspartner. Ab jetzt ändert sich die Perspektive grundlegend. In diesem Teil machen

-

Ein Copilot-System ist längst nicht mehr nur ein Feature großer Anbieter wie Microsoft oder GitHub – es ist ein Konzept: Künstliche Intelligenz, die nicht nur antwortet, sondern aktiv

-

Vom Sprachmodell zum echten lokalen KI-System Bis hierher ist klar: Ein LLM formuliert gut – aber erst RAG liefert Wissen. Jetzt bauen wir das Ganze praxisnah zusammen: Ollama als Generator, Qdrant

-

KI & moderne Workflows Node-RED als Orchestrator für LLMs, Daten & Entscheidungen Ziel: Zukunftsszenarien realistisch nutzbar machen. Ergebnis: Du setzt Node-RED als KI-Orchestrator ein –

-

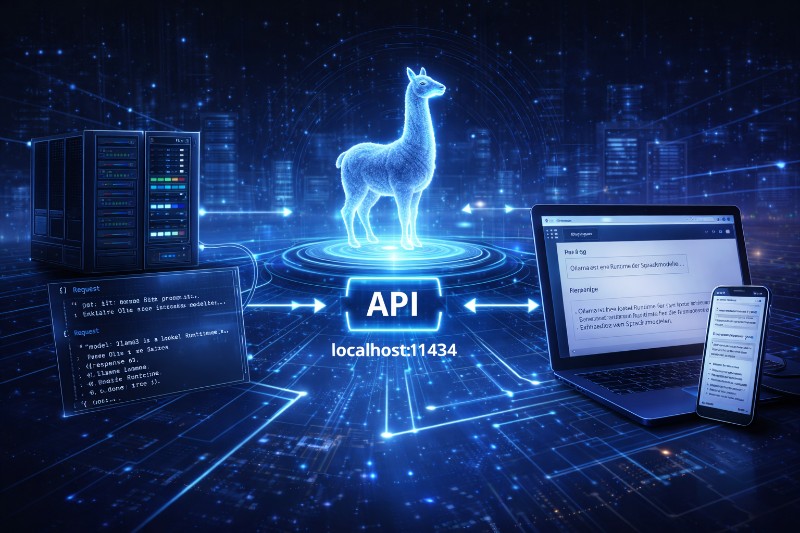

Warum Ollama erst als Backend richtig stark wird Bis hierhin hast du Ollama wahrscheinlich interaktiv genutzt: ollama run, ein bisschen Chat, ein paar Tests. Das ist nett – aber nicht der

-

Wer Open WebUI sinnvoll einsetzen will, sollte nicht nur wissen, was es kann, sondern auch wie es intern arbeitet. Genau hier trennt sich schnell Spielerei von professionellem Einsatz. In diesem Teil